各国のAI法令・ガイドライン- 第2回:ASEAN –

各国のAI法令・ガイドラインに関するニュースレターを発行いたしました。第2回の今回は、ASEANとなっております。こちらの内容は、以下のリンクよりPDF版でもご覧いただけます。

→各国のAI法令・ガイドライン – 第2回:ASEAN –

各国のAI法令・ガイドライン

– 第2回:ASEAN –

2026年1月

One Asia Lawyers Group

AI法務プラクティスグループ

ニューヨーク州法弁護士 友藤 雄介

1. はじめに

インドネシアのAIに関するガイドラインを取り上げた第1回[1]に続き、本稿では第2回としてASEANが2024年に公表したAIガバナンス・倫理ガイドラインを紹介します。本稿執筆の背景については、第1回の冒頭をご参照ください。

2. ASEAN人工知能ガバナンス・倫理ガイドライン(ASEAN Guide on AI Governance and Ethics)

(1) 概要

ASEANは、2024年2月に人工知能ガバナンス・倫理ガイドライン(ASEAN Guide on AI Governance and Ethics[2]、以下「本ガイドライン」)を公表しました。本ガイドラインは法的拘束力を有するものではなく、各国政府や企業がAIを安全かつ倫理的に設計・運用する際の共通指針と位置づけられます。内容からは、欧州モデルを意識したリスクベースの考え方を取り入れつつ作成されたことがうかがえますが、リスク発生の蓋然性とその影響の大きさを元にリスクを低・中・高に分類するに留め、EUの様に容認出来ないリスクとして特定のAI活用を禁止する類型に関する規定や、どの様なAIシステムが高リスクに該当するかと言った規定は設けられておりません。

(2) 本ガイドラインの構成

本ガイドラインは以下のとおり構成されています。

- Executive Summary

- A. 導入(Introduction)

- B. フレームワークのための指導原則(Guiding Principles for the Framework)

- C. AIガバナンス・フレームワーク(AI Governance Framework)

- D. 国家レベルでの提言(National-Level Recommendations)

- E. ASEAN域内レベルでの提言(Regional-Level Recommendations)

- F. 結論(Conclusion)

- Annex A: AIリスク影響評価テンプレート(AI Risk Impact Assessment Template)

- Annex B: 参考事例(Use Cases)

以下、概要を説明してまいります。

(3) 本ガイドラインの目的(本ガイドラインの項目 A.1)

ASEAN AIガイドラインは、域内におけるAIの責任ある利活用を促進するため、主に以下の目的で策定されています。

- 政府による政策形成の参考となること

ASEAN加盟国政府が AI の設計・開発・実装に関する政策を策定する際の推奨事項および政策ガイダンスを提供すること - 企業・民間組織に対する実務的な指針の提供

ASEAN 域内の企業・民間組織がAIを設計・開発・導入する際の実践的なガイドとして機能すること。

後者の企業・民間組織に対しては、特に利用者・市民社会との信頼構築のために、本ガイドラインが提供するAIに関連するリスクの評価方法に基づいて、AIに伴うリスクを適切に評価し、必要な対策を講じることが推奨されています。

なお、本ガイドラインは「生きた文書(Living Document)」として位置づけられており、AI技術や関連規制の進展に応じて今後も定期的に更新されることが想定されています。

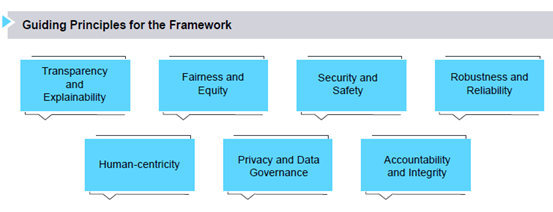

(4) 指導原則(Guiding Principles)(本ガイドラインの項目 B.)

本ガイドラインは、AIを設計・運用する上で遵守すべき7つの指導原則を以下の図の通り提示しています。

上記7つの指導原則が要請する内容の概要を以下に説明します。

a. 透明性と説明可能性(Transparency & Explainability)

・透明性:以下の事項の開示

・AIの使用場面

・AIの意思決定への関与の度合い

・AIが利用するデータ

・AIの利用目的

・説明可能性:AIによる意思決定の背後の理由を説明する能力の保持

b. 公平性と公正性(Fairness & Equity)

・以下を防ぐための安全策の装備

・様々な人口統計における既存の差別的または不当な影響の更なる悪化

・AIの設計、開発、および実装による不当な偏りや差別の招来

c. セキュリティと安全性(Security & Safety)

・セキュリティ対策の実践

具体的には、サイバーセキュリティの確保であり、データ汚染、モデル反転、データセットの改ざん等のAIに特有する悪意のある攻撃等に対するメカニズムを講じること

・安全策の実践

具体的には、影響及びリスクの評価の実施による既知のリスクの特定・軽減の確認)を講じること

d. 人間中心主義(Human-Centricity)

・人間中心主義の実践

具体的にはAIが人間中⼼の価値観を尊重し、人間の福祉、栄養、幸福など、人間社会への利益を追求するものであること

e. プライバシーとデータガバナンス(Privacy & Data Governance)

・以下の保護のための適切な仕組みの装備

・データのプライバシーと保護

・データの品質と完全性

f. 説明責任と誠実性(Accountability & Integrity)

・AIによる意思決定、適用法令の遵守、AI倫理及び原則の尊重に対する説明責任の保持

・AIのライフサイクル全体を通じた誠実な行動の実践

g. 堅牢性と信頼性(Robustness & Reliability)

・多様な状況下で安定的に機能する仕組みの担保

・一貫したパフォーマンスの発揮

(5) AIガバナンス・フレームワーク(企業向け)(本ガイドラインの項目 C.)

本ガイドラインは、内部統制の分野に関連して企業等が整備すべき4つの領域を挙げています。

a. 内部統制体制の構築

・AI倫理委員会(AI Ethics Board)の設置

本ガイドラインでは、複雑かつ多岐にわたるAIの倫理的課題への対処のための異なる分野の専門家によって構成することを提言しています。

・多層的な管理体制の構築

リスク度合いに応じた管理体制の構築(高リスクのAIには、強固な管理が行われる様な体制を構築すること)の必要性を強調しています。

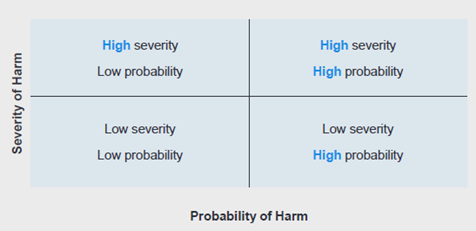

b. AIの意思決定への人間の関与レベルの決定

リスク評価結果(特にリスクの発生度合いとリスクの影響度合いによって、高・中・低に分類した上での評価結果)を踏まえて、AIに対する人間の関与を以下の通り分類し、それに基づいて人の関与を以下の様に確保することを推奨しています。

・人間参加型(Human-in-the-loop)

最終的な意思決定は人間が行うもので、AIは補助的な情報を提供することに留めるべきとされるもの。具体的には、医師による患者の病状の診断にAIを用いることが挙げられている。

・人間監視型(Human-over-the-loop)

平常時のAIシステムの稼働には、人間の関与は行わないものの、意図した通りに動作しない場合や、予期せぬ自体に遭遇した場合等に日本源がAIして有無の意思決定に介入することができるようにするべきとされるもの。具体的には、自動車の自動運転の完全運転モードが挙げられています

・人間不介入型(Human-out-of-the-loop)

上記以外のもので、人間の介入を不要とするもの。具体的には、アルゴリズムを用いた推奨システムが挙げられています。

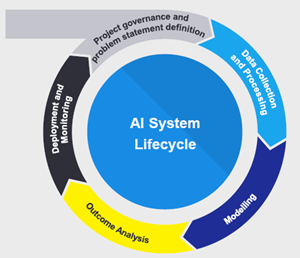

c. 運用管理(Operations Management)

本項目では、AIシステムのライフサイクルを以下の5項目に分類の上、それぞれにおいて考慮すべき項目を挙げています。本項目は、本ガイドライン上において最も紙面を割いている箇所であり、実務者に取って参照すべき実務的な内容が含まれている箇所かと存じます。

・AIシステムのプロジェクトガバナンス構築と解決するべき課題の定義(Project Governance and problem statement definition)

・データ収集・処理

・モデル設計

・結果検証

・実装及び監視

d. ステークホルダーとの交流・コミュニケーション

AIの設計・開発・実装の全過程を通じて、関係者との信頼関係を構築するために適切な手順を踏むことが重要であるとして、以下を検討するべきとしています。

・AIを使用している場合、その目的・利用されているAIの種類等の開示

・AI導入による業務の変質(AIの導入により業務の効率化によって社員を利する場合のみならず、一部社員の役割が不要になることも含む)を踏まえた社員への教育・研修及び職務の再設計

・AI利用に関するフィードバックチャネルの構築

(6) 国家・ASEANへの取組の提言(本ガイドラインの項目 D.及びE.)

本ガイドラインのD及びEにて、加盟国政府と、今後ASEAN域内で取り組むべき内容として以下を提示しています。

a. 国家レベル(National-level Recommendations)

・AI人材育成・労働者のスキルアップ

・AIスタートアップの投資促進

・AI研究開発への投資

・企業での本ガイドラインの実装に役立つツール(例:シンガポールにおけるAI Verify)の普及

・AIが社会に与える影響に関する国民への啓蒙

b. ASEAN域内レベル(Regional-level Recommendations)

・ASEAN AIガバナンス作業部会(Working Group)の設置

・ガイドラインの「生成AI(Generative AI)」版への拡張

・ASEAN域内企業の参考事例集の作成

(7) 結論(本ガイドラインの項目 F.)

本ガイドラインの結論部分では、ASEANの目的の一つとして掲げられている、経済・社会・技術・科学分野における加盟国間の協力・相互支援の下、本ガイドラインがASEAN各国が共同で作成した「AIガバナンス・倫理に関する域内のベストプラクティス集」であることが強調されています。

同時に、本ガイドラインは、ASEAN域内の企業や政府機関がAI技術を設計・開発・導入する際に参照すべき実務的な手引き(プラクティカル・ガイド)であり、今後の技術・規制の進展に応じて定期的に見直される「生きた文書(living document)」であることが明記されています。

また、本ガイドラインの適用は任意であり、各加盟国の国内法令上の義務や権利を変更するものではないことも示されています。

(8) AIリスク影響評価テンプレート(本ガイドラインのAnnex A)

Annex A では、AI リスク影響評価(AI Risk Impact Assessment)のテンプレートが提示されています。本テンプレートは、シンガポールPDPC(個人情報保護委員会)の組織向け実装及び自己評価ガイド(Implementation and Self-Assessment Guide for Organizations)を元に作成されており、以下の大項目に分かれています。

・AIの実装目的

・内部ガバナンス体制と方法

・AIの意思決定への人間の関与レベルの決定

・運用管理

・ステークホルダーとの交流とコミュニケーション

(9) 各企業ごとのAI利用ケースの紹介(本ガイドラインのAnnex B)

Annex Bでは、ASEAN域内で AI ガバナンスを実践している企業・政府機関の具体的参考事例が紹介されています。

・Aboitiz Group(フィリピン)

・Ernst & Young

・Gojek(インドネシア)

・AI(シンガポール)

・シンガポール国家AIオフィス(シンガポール政府)

・シンガポール教育省

3. 総括

ASEAN AIガイドは法的拘束力を持たないものの、ASEAN域内企業がAIを扱う際にこれを参考にすることが推奨されております。ASEAN各国は、今後このガイドを踏まえた法令整備に進む可能性もあり、EU AI法との整合性を意識した動きも想定されます。

———-

[1] 2025年11月ニュスレター「各国の AI 法令・ガイドライン‐第1回:インドネシア‐」

[2] ASEAN Guide on AI Governance and Ethics